從月餅包裝看古今智慧 當現代過度包裝遇上古代皮革簡樸美學

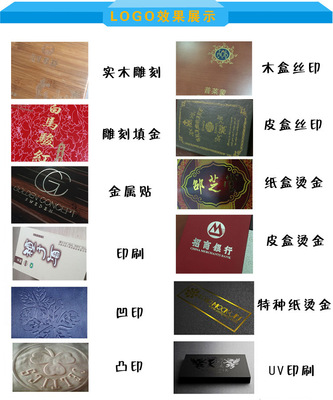

每逢中秋佳節,琳瑯滿目的月餅禮盒總是引發關于環保與浪費的熱議。現代月餅包裝往往層層疊疊,從燙金紙盒到絲綢內襯,從塑料隔層到金屬裝飾,最后才見到小小的月餅本身。這種“買櫝還珠”式的過度包裝,不僅消耗大量資源,更在節日后產生成堆難以回收的廢棄物。

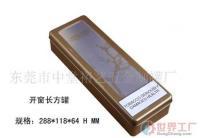

反觀古代,人們卻展現出一種質樸而智慧的包裝哲學。古籍與文物顯示,古人常用天然皮革制作包裝盒——無論是儲存貴重物品,還是攜帶干糧點心。皮革盒經久耐用,可反復使用數年甚至數十年;其材質源于自然,最終也能回歸自然循環。更重要的是,皮革盒本身就成為一件可傳承的生活器物,承載著超越一次性消費的情感價值。

這種對比揭示出兩種截然不同的設計思維:現代包裝追求“即時驚艷”,用華麗外表刺激消費;古代包裝則注重“長效實用”,在簡約中體現對物品與自然的尊重。古人深知“器以載道”——包裝不僅是容器,更是生活哲學的延伸。一個結實的皮革盒,既能保護內容物,又能隨主人跋山涉水,成為旅途中的忠實伴侶。

我們不必完全復古采用皮革包裝,但古人的智慧值得借鑒:

- 材料選擇:優先使用可降解、可再生的天然材料

- 功能設計:讓包裝本身具有二次使用價值

- 文化承載:通過簡約設計傳遞更深層的文化意蘊

- 生命周期思維:從制作之初就考慮廢棄后的去向

當下已有品牌推出可重復使用的月餅罐、可轉化為收納盒的包裝設計,這正是古今智慧的當代回響。真正的“聰明”,或許不在于包裝多么炫目,而在于如何用最少的資源,實現保護產品、傳遞情感、善待環境的多元平衡。當我們在中秋月下品味月餅時,或許也該思考:我們留給后人的,除了甜蜜記憶,是否還有一堆無法降解的包裝垃圾?回歸質樸、崇尚實用的古老智慧,在這個過度消費的時代,正閃爍著新的啟示之光。

如若轉載,請注明出處:http://www.cphk.com.cn/product/56.html

更新時間:2026-04-14 00:37:34